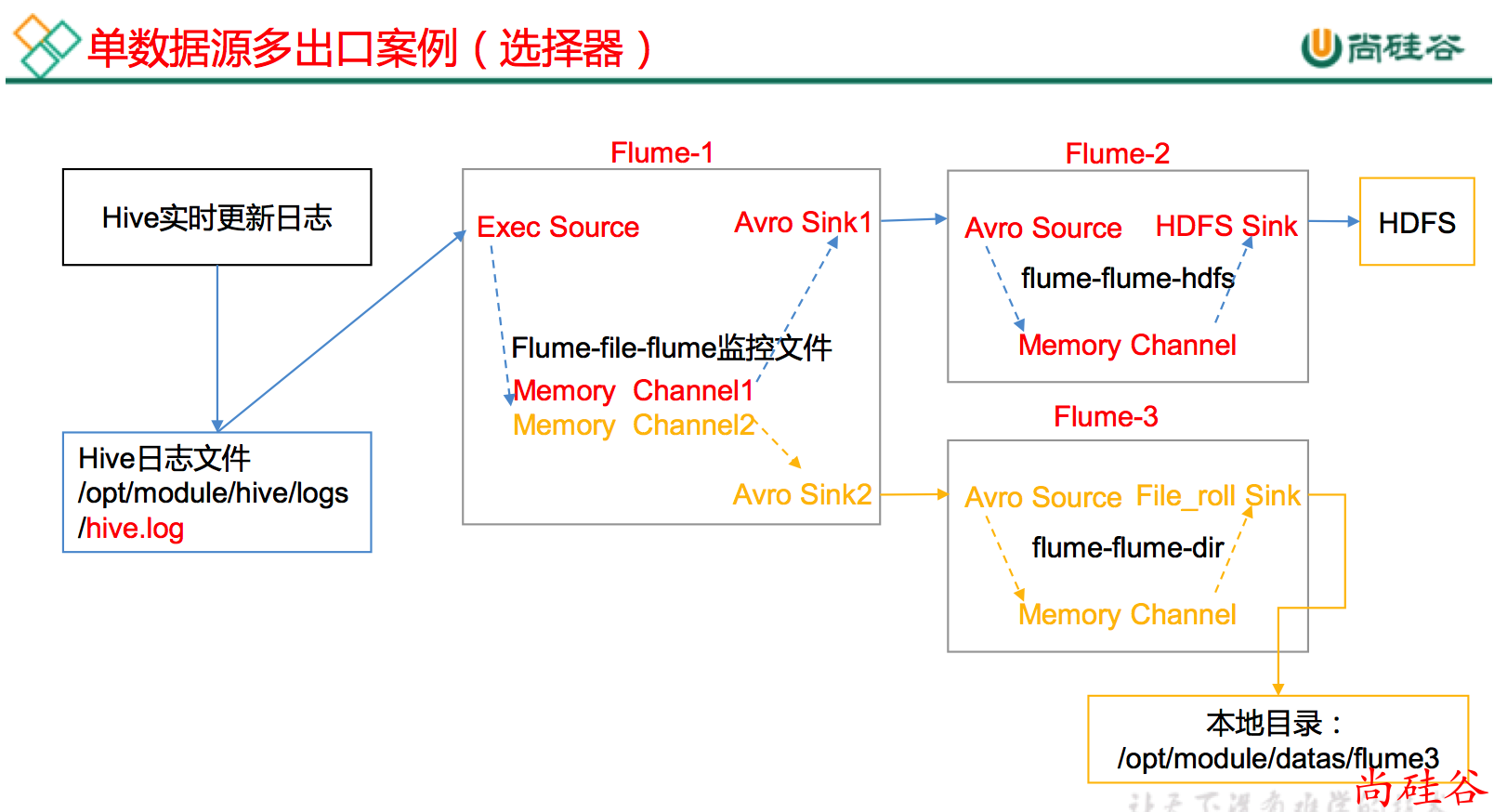

3.4 单数据源多出口案例(选择器)

3.4.1 案例需求

使用 Flume-1 监控文件变动,Flume-1 将变动内容传递给 -2,Flume-2 负责存储到HDFS。 同时 Flume-1 将变动内容传递给 Flume-3,Flume-3 负责输出到Local FileSystem。

3.4.2 需求分析

3.4.3 操作步骤

步骤1: 准备工作

创建两个目录:

在

/opt/module/flume/job目录下创建一个目录group1, 将来在这个目录下存放我们 3 个 agent 的配置文件.在

/opt/module/datas目录下创建一个目录flume3, 这个目录作为flume3sink数据的目录.

步骤2: 创建 agent1 的配置文件

文件名: flume-file-flume.conf

文件内容如下:

# Name the components on this agent

a1.sources = r1

a1.sinks = k1 k2

a1.channels = c1 c2

# 将数据流复制给所有channel

a1.sources.r1.selector.type = replicating

# Describe/configure the source

a1.sources.r1.type = exec

a1.sources.r1.command = tail -F /opt/module/hive-2.3.3/logs/hive.log

a1.sources.r1.shell = /bin/bash -c

# Describe the sink

a1.sinks.k1.type = avro

a1.sinks.k1.hostname = hadoop201

a1.sinks.k1.port = 4141

a1.sinks.k2.type = avro

a1.sinks.k2.hostname = hadoop201

a1.sinks.k2.port = 4142

# Describe the channel

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

a1.channels.c2.type = memory

a1.channels.c2.capacity = 1000

a1.channels.c2.transactionCapacity = 100

# Bind the source and sink to the channel

a1.sources.r1.channels = c1 c2

a1.sinks.k1.channel = c1

a1.sinks.k2.channel = c2

说明:

- Avro 是由 Hadoop 创始人 Doug Cutting 创建的一种语言无关的数据序列化和 RPC 框架。

- RPC(Remote Procedure Call)远程过程调用,它是一种通过网络从远程计算机程序上请求服务,而不需要了解底层网络技术的协议。

步骤3: 创建 agent2 的配置文件

上级是agent1, sink 到 HDFS

文件名: flume-flume-hdfs.conf

文件内容如下:

# Name the components on this agent

a2.sources = r1

a2.sinks = k1

a2.channels = c1

# Describe/configure the source

a2.sources.r1.type = avro

a2.sources.r1.bind = hadoop201

a2.sources.r1.port = 4141

# Describe the sink

a2.sinks.k1.type = hdfs

a2.sinks.k1.hdfs.path = hdfs://hadoop201:9000/flume2/%Y%m%d/%H

#上传文件的前缀

a2.sinks.k1.hdfs.filePrefix = flume2-

#是否按照时间滚动文件夹

a2.sinks.k1.hdfs.round = true

#多少时间单位创建一个新的文件夹

a2.sinks.k1.hdfs.roundValue = 1

#重新定义时间单位

a2.sinks.k1.hdfs.roundUnit = hour

#是否使用本地时间戳

a2.sinks.k1.hdfs.useLocalTimeStamp = true

#积攒多少个Event才flush到HDFS一次

a2.sinks.k1.hdfs.batchSize = 100

#设置文件类型,可支持压缩

a2.sinks.k1.hdfs.fileType = DataStream

#多久生成一个新的文件

a2.sinks.k1.hdfs.rollInterval = 600

#设置每个文件的滚动大小大概是128M

a2.sinks.k1.hdfs.rollSize = 134217700

#文件的滚动与Event数量无关

a2.sinks.k1.hdfs.rollCount = 0

#最小冗余数

a2.sinks.k1.hdfs.minBlockReplicas = 1

# Describe the channel

a2.channels.c1.type = memory

a2.channels.c1.capacity = 1000

a2.channels.c1.transactionCapacity = 100

# Bind the source and sink to the channel

a2.sources.r1.channels = c1

a2.sinks.k1.channel = c1

步骤4: 创建 agent3 的配置文件

上级是agent1 sink 到本地目录

文件名: flume-flume-dir.conf

文件内容如下:

# Name the components on this agent

a3.sources = r1

a3.sinks = k1

a3.channels = c2

# Describe/configure the source

a3.sources.r1.type = avro

a3.sources.r1.bind = hadoop201

a3.sources.r1.port = 4142

# Describe the sink

a3.sinks.k1.type = file_roll

a3.sinks.k1.sink.directory = /opt/module/datas/flume3

# Describe the channel

a3.channels.c2.type = memory

a3.channels.c2.capacity = 1000

a3.channels.c2.transactionCapacity = 100

# Bind the source and sink to the channel

a3.sources.r1.channels = c2

a3.sinks.k1.channel = c2

注意:

- 输出的本地目录必须是已经存在的目录,如果该目录不存在,并不会创建新的目录。

步骤5: 分别启动 3 个 Flume

flume-ng agent -c conf -f job/group1/flume-flume-dir.conf -n a3

flume-ng agent -c conf -f job/group1/flume-flume-hdfs.conf -n a2

flume-ng agent -c conf -f job/group1/flume-file-flume.conf -n a1

步骤5: 启动集群和 Hive

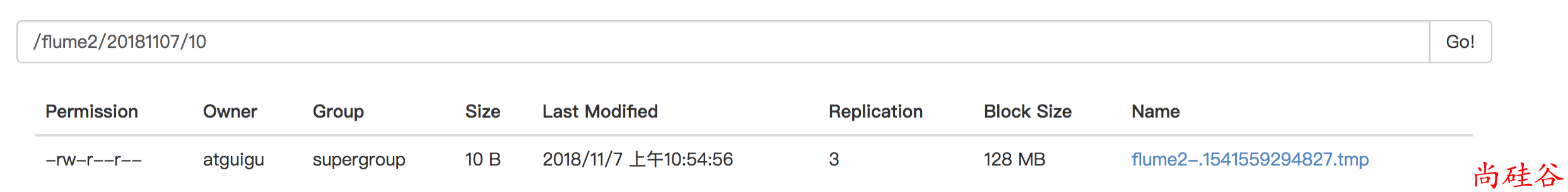

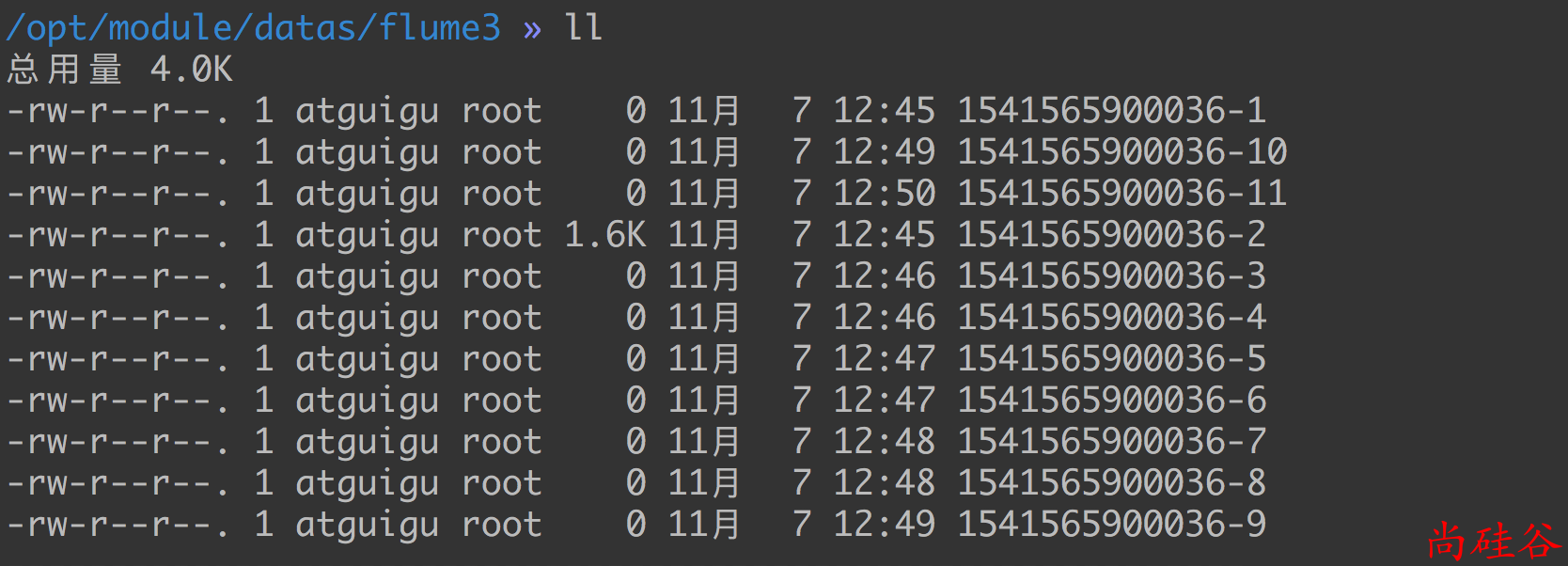

步骤6: 检测 HDFS 和 本地目录上的数据